电脑本地跑上最新的deepseek-r1

本文主要通过介绍安装ollama,使用ollama安装deepseek-r1,在安装Page Assist,从无到有在本地pc把最近最火的deepseek跑起来。

安装ollama

ollama是什么?

Ollama 是一个开源的大型语言模型服务工具,旨在简化在本地运行大语言模型的过程,降低使用门槛。

如何安装ollama?

- 下载:访问Ollama官方网站,点击下载按钮,选择 Windows 平台对应的安装包进行下载。

- 安装:下载完成后,双击安装包,按照安装向导的提示完成安装。

- 更换默认安装路径:直接双击安装ollama会默认安装到C盘,我们可以使用这个方法来指定安装路径。

1OllamaSetup.exe DIR="D:\soft\ollama"- 更改模型存储位置:在用户账户中设置一个名字叫“OLLAMA_MODELS”的环境变量,变量值就是你希望存储模型的位置,我设置的是“D:\llms”。

- 验证:打开命令提示符(CMD)或 PowerShell,输入ollama -v,若显示 Ollama 的版本信息,则说明安装成功。

1Ollama -v1ollama version is 0.5.7

使用ollama安装deepseek-r1

安装deepseek-r1的默认版本

deepSeek:r1版本提供了多种参数量的模型,安装指令不跟参数就是安装默认的7B版本。

| |

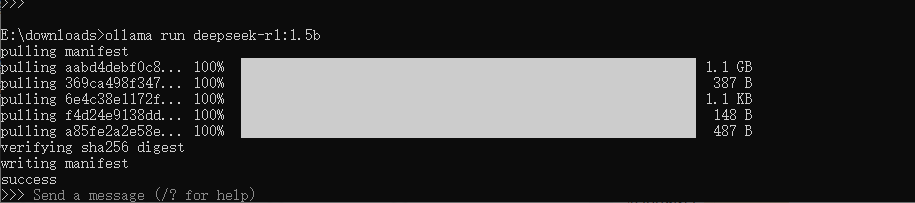

安装deepseek-r1的其他版本

在上面的指令后面跟上参数量就可以安装其他版本,可以安装的有1.5b、7b、8b、14b、32b、70b和671b。

| |

理论上,参数规模的区别,模型越大参数数量逐渐增多,参数数量越多,模型能够学习和表示的知识就越丰富,理论上可以处理更复杂的任务,对各种语言现象和语义理解的能力也更强。比如在回答复杂的逻辑推理问题、处理长文本上下文信息时,70B的模型可能会比1.5B的模型表现得更出色。同时,需要计算量和消耗的资源也就越大,可以根据硬件来选择合适的版本安装。

安装Page Assist

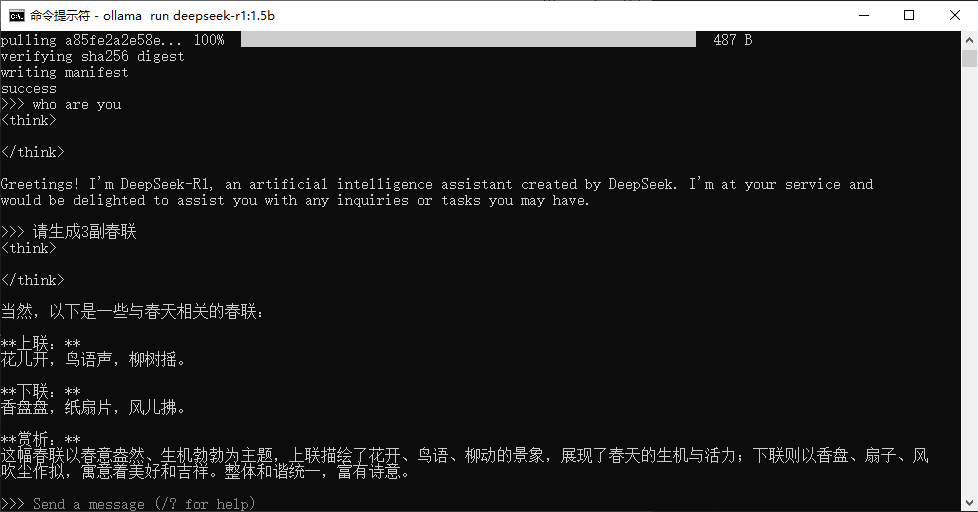

完成上面的步骤之后,在命令行就可以直接使用模型了。

但命令行使用起来不太方便,也不符合大多数人的习惯。我们可以使用一些工具来提高交互效果,比如通过安装Chrome插件来进行图形化交互。

通过github安装Page Assist

我是在GitHub上找的这样一个插件,它支持chrome(只要使用chromium的都可以)和firefox,我们可以在这里下载最新的版本。安装过程自己摸索,当然你也可以在chrome的插件商店上找到并安装。

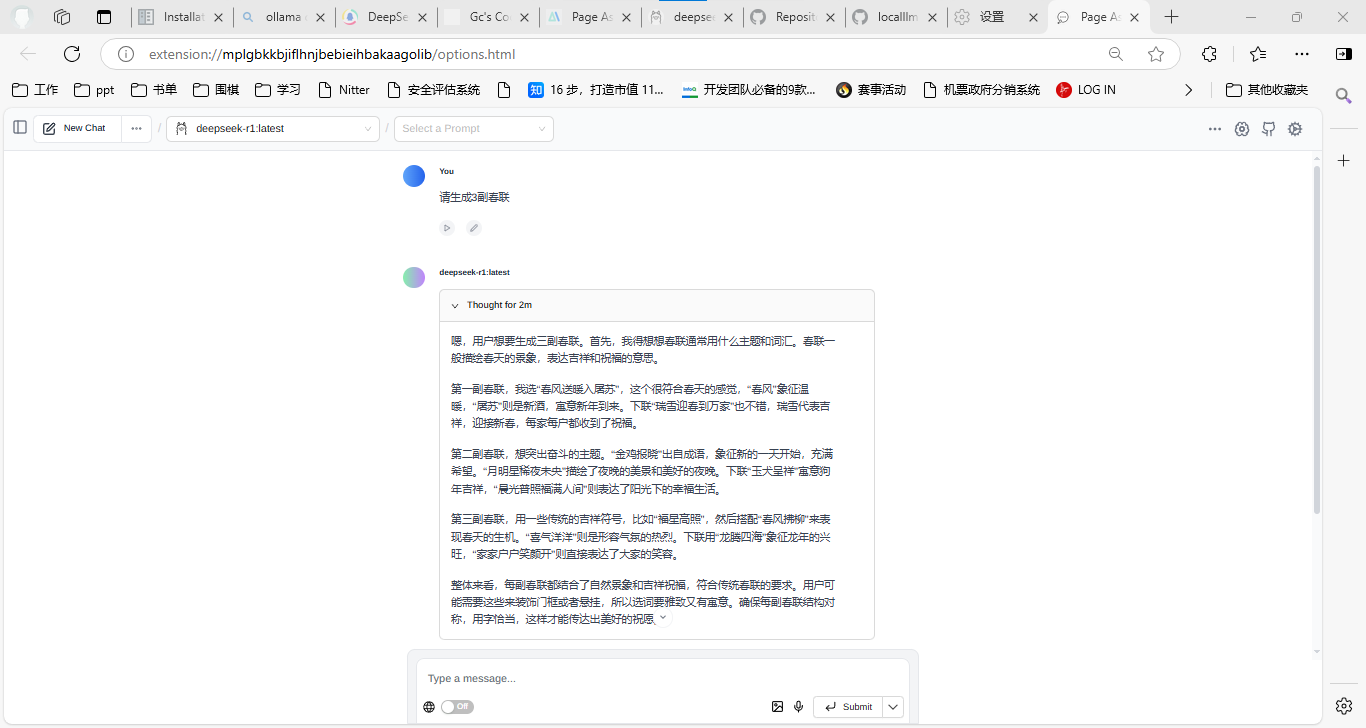

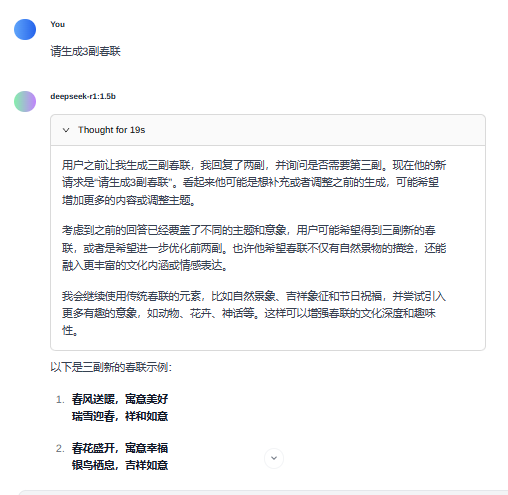

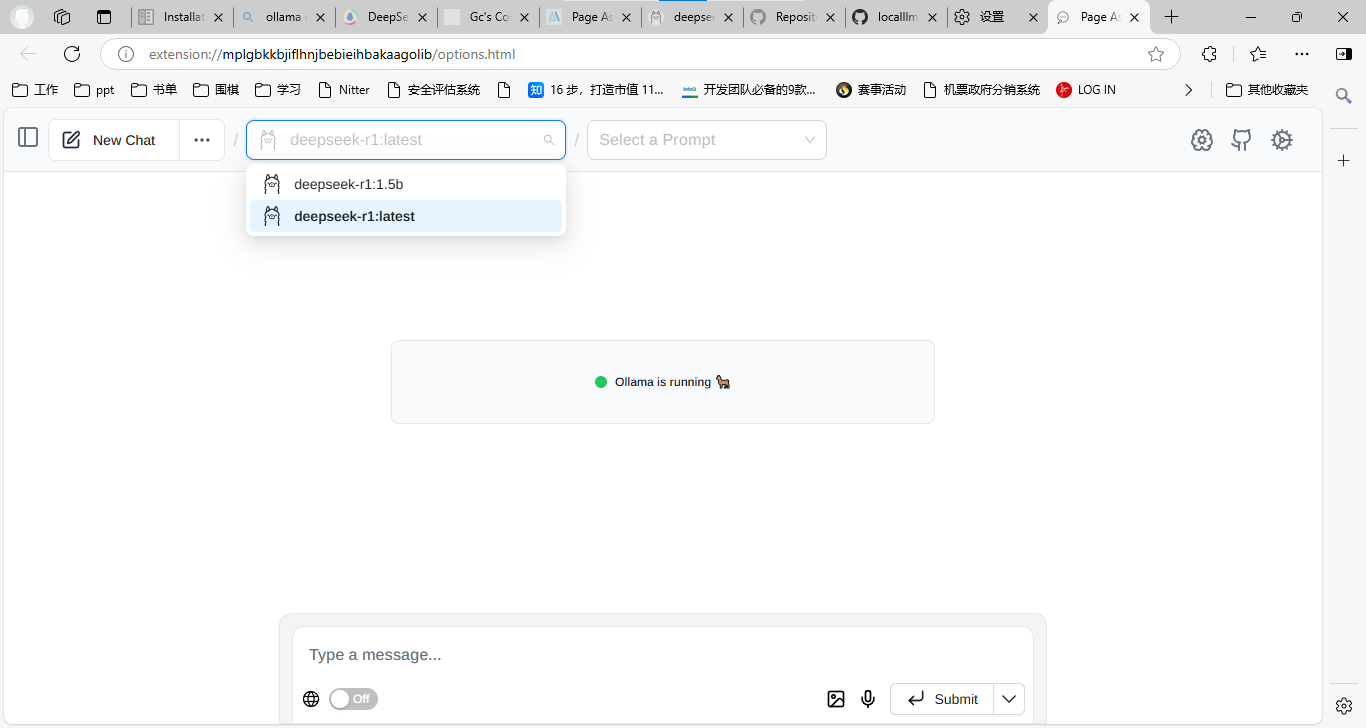

使用Page Assist

可以看下效果: